Les postes de travail et les serveurs sont les deux piliers les plus exposés de votre système d’information. Les premiers concentrent les usages quotidiens, messagerie, navigation web, accès aux applications métiers. Les seconds hébergent les fichiers, bases de données, applications, annuaires et services critiques. Si l’un de ces éléments est mal protégé, toute l’entreprise peut être touchée.

Une bonne stratégie de cybersécurité informatique ne commence donc pas forcément par des outils complexes. Elle commence par un socle solide : des équipements inventoriés, à jour, correctement configurés, surveillés et sauvegardés. Pour une PME en Martinique, Guadeloupe ou Guyane, cette base est d’autant plus importante que les contraintes locales, disponibilité des compétences, délais matériels, connectivité inter-sites, risques climatiques, peuvent rallonger le retour à la normale après incident.

Voici une méthode concrète pour renforcer la sécurité de vos postes et serveurs sans perdre de vue l’efficacité opérationnelle.

Pourquoi postes et serveurs doivent être sécurisés ensemble

Un poste utilisateur compromis peut devenir une porte d’entrée vers les serveurs. C’est le scénario classique : un collaborateur clique sur une pièce jointe piégée, l’attaquant récupère des identifiants, puis cherche à atteindre un serveur de fichiers, un serveur applicatif ou l’annuaire de l’entreprise.

À l’inverse, un serveur mal configuré peut exposer des données sensibles, créer des interruptions de service ou servir de point de rebond vers d’autres machines. La sécurité ne doit donc pas être pensée équipement par équipement, mais comme une chaîne. Chaque maillon doit limiter la propagation d’une attaque.

Les recommandations de l’ANSSI sur l’hygiène informatique rappellent notamment l’importance de maîtriser le parc, gérer les comptes, appliquer les mises à jour et sauvegarder les données. Ces principes peuvent sembler basiques, mais ils restent les fondations les plus efficaces.

Le socle minimal : connaître, classer, protéger

Avant de renforcer la protection technique, il faut savoir ce que l’on protège. Beaucoup d’incidents commencent par un angle mort : un ancien serveur encore actif, un PC non supervisé, une application non maintenue, un compte administrateur oublié.

Un inventaire fiable doit couvrir les postes fixes, ordinateurs portables, serveurs physiques, machines virtuelles, équipements réseau, logiciels installés, systèmes d’exploitation, comptes à privilèges et accès distants. Cet inventaire doit être mis à jour régulièrement, pas seulement au moment d’un audit.

| Élément à maîtriser | Objectif sécurité | Exemple d’action concrète |

|---|---|---|

| Parc postes et serveurs | Savoir ce qui est connecté au SI | Tenir un inventaire avec nom, usage, utilisateur, OS et criticité |

| Versions systèmes et logiciels | Réduire les failles connues | Identifier les systèmes obsolètes et planifier les mises à jour |

| Comptes utilisateurs et administrateurs | Limiter les accès inutiles | Supprimer les comptes dormants et séparer les comptes admin |

| Données hébergées | Prioriser la protection | Classer les données sensibles, métiers et réglementaires |

| Exposition réseau | Réduire la surface d’attaque | Fermer les services inutiles et filtrer les accès entrants |

Cette cartographie permet de prioriser. Un serveur de paie, un contrôleur de domaine ou un serveur métier critique ne doit pas être traité comme un simple poste bureautique. De même, un ordinateur portable utilisé en télétravail ou en déplacement doit bénéficier de protections adaptées.

Durcir les postes de travail : là où les attaques commencent souvent

Les postes utilisateurs sont les équipements les plus sollicités et donc les plus exposés. Ils accèdent à Internet, reçoivent des emails, ouvrent des documents externes et se connectent parfois depuis des réseaux non maîtrisés.

Maintenir les systèmes et applications à jour

Les mises à jour ne concernent pas seulement Windows, macOS ou Linux. Les navigateurs, suites bureautiques, clients PDF, outils métiers, agents VPN et logiciels de visioconférence doivent aussi être suivis. Une faille dans une application très utilisée peut suffire à compromettre un poste.

La bonne pratique consiste à définir un cycle de patching clair : test sur un petit groupe, déploiement progressif, contrôle de conformité. Les correctifs critiques doivent être traités rapidement, notamment lorsqu’une faille est activement exploitée. Le catalogue Known Exploited Vulnerabilities de la CISA peut aider les équipes IT à prioriser les vulnérabilités les plus urgentes.

Supprimer les droits administrateur inutiles

Un utilisateur standard ne devrait pas être administrateur local de son poste au quotidien. C’est l’une des mesures les plus efficaces pour limiter l’installation de logiciels malveillants, le contournement de protections ou la modification de paramètres sensibles.

Pour les besoins ponctuels, il est préférable d’utiliser une élévation contrôlée, un compte séparé ou une intervention du support. Cette séparation réduit fortement l’impact d’un phishing ou d’un malware exécuté par erreur.

Protéger les accès et les sessions

Un poste sécurisé doit imposer des mots de passe robustes, un verrouillage automatique de session, le chiffrement du disque et, lorsque c’est possible, une authentification multifacteur pour les services sensibles. Le chiffrement est particulièrement important pour les ordinateurs portables, car la perte ou le vol d’un équipement peut entraîner une fuite de données.

Les ports USB, impressions locales, partages de fichiers et synchronisations cloud personnelles doivent aussi être encadrés. L’objectif n’est pas de bloquer le travail, mais d’éviter les chemins non maîtrisés de sortie ou d’entrée des données.

Déployer une protection centralisée

Un antivirus moderne ou une solution EDR permet de détecter des comportements suspects, isoler un poste, remonter des alertes et analyser les incidents. L’intérêt est surtout la centralisation : une protection installée mais non supervisée perd beaucoup de sa valeur.

Les postes doivent également remonter des journaux exploitables. En cas d’incident, ces traces aident à comprendre ce qui s’est passé : compte utilisé, fichier exécuté, serveur contacté, heure de propagation.

Sécuriser les serveurs : réduire l’exposition et contrôler les privilèges

Les serveurs concentrent les ressources critiques. Leur sécurisation doit être plus stricte que celle des postes, car une compromission peut avoir des conséquences directes sur la production, la facturation, les données clients ou la continuité d’activité.

Appliquer le principe du moindre service

Un serveur ne devrait exécuter que les services nécessaires à son rôle. Plus il héberge de fonctions, plus sa surface d’attaque augmente. Il est donc recommandé de séparer les rôles lorsque c’est possible : serveur de fichiers, serveur applicatif, base de données, annuaire, sauvegarde, supervision.

La virtualisation facilite cette séparation, tout en améliorant la restauration et l’évolutivité. Elle doit cependant être elle-même sécurisée : hyperviseur à jour, accès administrateur contrôlés, réseau de gestion isolé, sauvegardes cohérentes.

Fermer les accès directs inutiles

Les accès d’administration à distance, notamment RDP, SSH, consoles hyperviseur et interfaces web d’administration, ne doivent jamais être exposés sans filtrage. L’accès doit passer par un VPN, un bastion, une restriction d’adresses IP ou une authentification renforcée.

Pour les PME aux Antilles-Guyane avec plusieurs sites ou collaborateurs itinérants, cette règle est essentielle. L’accès distant est souvent nécessaire, mais il doit être maîtrisé et journalisé.

Durcir les configurations

Les configurations par défaut sont rarement suffisantes. Les référentiels comme les CIS Benchmarks proposent des bases de durcissement pour de nombreux systèmes, applications et plateformes. Sans appliquer aveuglément toutes les recommandations, elles permettent de structurer les contrôles : services désactivés, politiques de mots de passe, chiffrement, journalisation, droits fichiers, paramètres réseau.

Le durcissement doit être documenté. Si personne ne sait pourquoi un paramètre a été modifié, il sera difficile de maintenir la sécurité dans le temps ou de résoudre un incident sans créer d’effet de bord.

Sauvegarder et tester la restauration

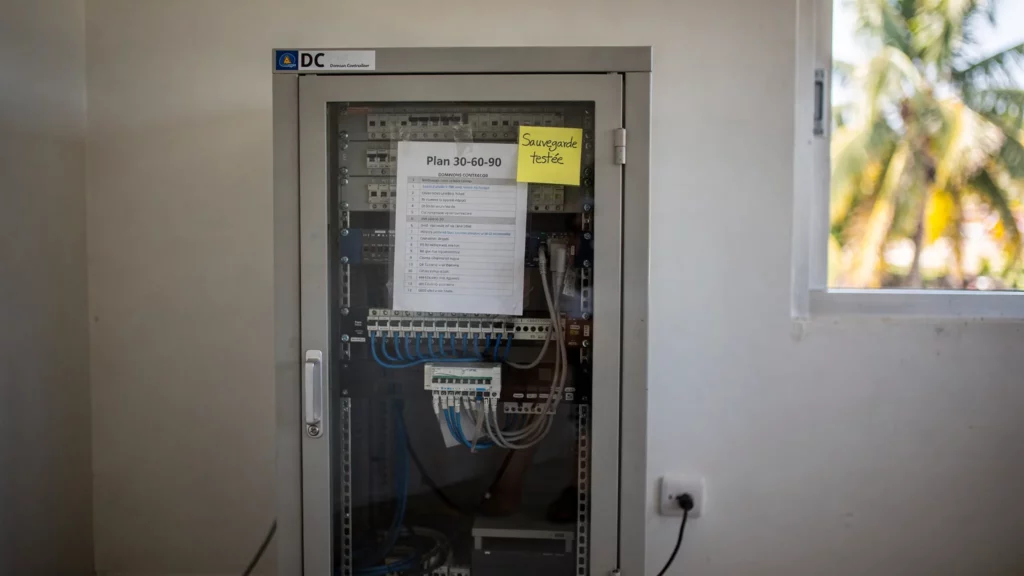

Un serveur sécurisé n’est pas seulement un serveur protégé contre l’intrusion. C’est aussi un serveur que l’on peut restaurer. Les sauvegardes doivent être automatisées, chiffrées, isolées des comptes administrateurs courants et testées régulièrement.

Un test de restauration vaut mieux qu’un tableau de sauvegardes au vert. Il permet de vérifier les délais réels, l’intégrité des données, les dépendances applicatives et la capacité de l’équipe à remettre le service en route. Pour les environnements critiques, ce travail doit s’intégrer à un plan de reprise d’activité.

Identités et mots de passe : le point commun entre postes et serveurs

Les attaquants cherchent rarement à tout casser immédiatement. Ils cherchent d’abord des identifiants. Un mot de passe réutilisé, un compte administrateur local identique sur plusieurs postes ou un compte ancien encore actif peut suffire à escalader les privilèges.

La gestion des identités doit donc reposer sur quelques règles simples :

- Utiliser des comptes nominatifs pour les utilisateurs et les administrateurs.

- Séparer les comptes bureautiques des comptes d’administration.

- Activer l’authentification multifacteur sur les accès critiques.

- Supprimer rapidement les comptes des collaborateurs sortants.

- Revoir régulièrement les groupes à privilèges.

- Éviter les comptes partagés, sauf cas très encadré et journalisé.

Dans un environnement Windows, l’annuaire Active Directory est souvent une cible prioritaire. Il doit être surveillé avec attention : groupes administrateurs, politiques de mots de passe, délégations, comptes de service, contrôleurs de domaine, accès aux journaux. Dans un environnement Linux, la même logique s’applique aux comptes sudo, clés SSH, comptes applicatifs et accès root.

Réseau, segmentation et supervision : empêcher la propagation

Même avec des postes et serveurs durcis, il faut prévoir qu’un incident puisse arriver. La question devient alors : jusqu’où l’attaque peut-elle aller ?

La segmentation réseau limite les déplacements latéraux. Un poste bureautique ne devrait pas avoir libre accès à tous les serveurs. Un réseau invité Wi-Fi ne doit pas communiquer avec les ressources internes. Les sauvegardes ne doivent pas être accessibles avec les mêmes droits que les fichiers de production.

La supervision permet ensuite de détecter les signaux faibles : connexions inhabituelles, échecs d’authentification répétés, augmentation anormale du trafic, création de comptes suspects, arrêt d’un agent de sécurité, modification massive de fichiers.

| Signal à surveiller | Risque potentiel | Réaction attendue |

|---|---|---|

| Connexions hors horaires habituels | Compte compromis | Vérifier l’utilisateur, forcer la réinitialisation si nécessaire |

| Échecs de connexion répétés | Brute force ou erreur de configuration | Bloquer la source et analyser les journaux |

| Désactivation d’un antivirus ou agent EDR | Tentative de contournement | Isoler l’équipement et ouvrir une investigation |

| Chiffrement massif de fichiers | Ransomware en cours | Couper les accès, préserver les traces, activer la procédure incident |

| Accès direct à un serveur depuis un poste non autorisé | Mouvement latéral | Contrôler les règles réseau et les droits du compte utilisé |

Une supervision efficace ne consiste pas à recevoir des centaines d’alertes non traitées. Elle doit être priorisée, contextualisée et associée à des procédures de réponse.

Une feuille de route simple pour renforcer postes et serveurs

Pour une PME, le plus difficile est souvent de savoir par où commencer. L’approche suivante permet d’avancer sans bloquer l’activité.

- Faire l’inventaire des équipements et comptes : Identifiez les postes, serveurs, logiciels, versions, comptes administrateurs et accès distants.

- Corriger les urgences visibles : Systèmes obsolètes, ports exposés, comptes dormants, sauvegardes absentes et antivirus non supervisés doivent être traités en priorité.

- Définir une configuration de référence : Créez un standard pour les postes utilisateurs, serveurs, droits locaux, pare-feu, chiffrement et journaux.

- Planifier les mises à jour : Mettez en place un calendrier de patching avec suivi, exceptions documentées et contrôle régulier.

- Sécuriser les accès privilégiés : Séparez les comptes administrateurs, activez la MFA et limitez les accès d’administration à distance.

- Tester la restauration et la réaction incident : Vérifiez que les sauvegardes fonctionnent et que l’équipe sait quoi faire en cas d’alerte.

Cette démarche peut être intégrée à un audit informatique pour obtenir une vision objective des priorités, des risques et des actions à mener.

Les erreurs fréquentes à éviter

La première erreur consiste à penser que l’achat d’un outil suffit. Un antivirus, un pare-feu ou une sauvegarde ne remplacent pas une configuration maîtrisée, une supervision active et des procédures connues.

La deuxième erreur est de sécuriser uniquement les serveurs. Les postes sont souvent le premier point de contact avec l’attaque. Un parc poste négligé finit par menacer les ressources centrales.

La troisième erreur est de garder des exceptions permanentes. Un logiciel ancien qui nécessite des droits administrateur, un serveur non mis à jour pour éviter une interruption, un accès distant ouvert « temporairement » peuvent devenir les failles les plus dangereuses du système d’information.

Enfin, beaucoup d’entreprises ne testent pas leurs sauvegardes. Or une sauvegarde non restaurable n’est pas une protection. Elle donne seulement une fausse impression de sécurité.

Pourquoi l’accompagnement local compte aux Antilles-Guyane

La cybersécurité informatique doit tenir compte du terrain. Une entreprise répartie entre plusieurs sites en Martinique, Guadeloupe et Guyane n’a pas les mêmes contraintes qu’une organisation centralisée en métropole. Les délais d’approvisionnement, les conditions climatiques, la disponibilité des techniciens, la qualité des liaisons et les besoins de continuité influencent directement les choix techniques.

Un partenaire local peut aider à définir des standards adaptés, mettre en place une infogérance, superviser les équipements, sécuriser les accès, accompagner les projets cloud ou virtualisation et intervenir plus rapidement en cas d’incident. L’objectif n’est pas seulement de corriger des failles, mais de construire un système plus fiable, plus maintenable et plus résilient.

AITEC accompagne les entreprises des Antilles-Guyane sur l’infogérance, la cybersécurité, le cloud, les audits, les réseaux, la virtualisation serveur et le support IT 24/7. Cette approche permet de relier la protection des postes et serveurs à une stratégie globale de continuité et de performance.

Questions fréquentes

Quelle est la première action à mener pour sécuriser postes et serveurs ? La première action consiste à réaliser un inventaire fiable du parc informatique, des versions logicielles, des comptes administrateurs et des accès distants. Sans cette visibilité, il est difficile de prioriser les corrections.

Un antivirus suffit-il pour protéger les postes de travail ? Non. L’antivirus est utile, mais il doit être complété par les mises à jour, la suppression des droits administrateur inutiles, le chiffrement, la MFA, la sensibilisation des utilisateurs et une supervision centralisée.

Faut-il appliquer toutes les mises à jour serveur immédiatement ? Les correctifs critiques doivent être traités rapidement, surtout s’ils concernent des failles exploitées. Pour les serveurs sensibles, il est recommandé de tester les mises à jour, planifier une fenêtre de maintenance et documenter les exceptions.

Comment sécuriser les accès distants aux serveurs ? Les accès distants doivent passer par un VPN, un bastion ou une solution contrôlée avec authentification multifacteur. Les services d’administration ne doivent pas être exposés directement sur Internet sans filtrage strict.

À quelle fréquence faut-il auditer la sécurité des postes et serveurs ? Un audit annuel est une bonne base, mais un contrôle doit aussi être réalisé après un changement majeur : migration cloud, nouveau serveur, réorganisation, incident, ouverture d’un accès distant ou déploiement d’une application critique.

Consolidez votre cybersécurité informatique avec AITEC

Sécuriser les postes et serveurs n’est pas un projet ponctuel. C’est une discipline continue qui combine configuration, maintenance, supervision, sauvegarde et réponse aux incidents.

Si vous souhaitez connaître le niveau réel de protection de votre infrastructure, AITEC peut vous accompagner avec un audit, des recommandations concrètes et une mise en œuvre adaptée à vos contraintes locales. Pour renforcer vos postes, serveurs, accès distants et sauvegardes, contactez AITEC Antilles et construisez un socle IT plus sûr pour votre activité.